djiuser_AGV69rYZrxCU

已累计飞行 0 米

机甲大师对抗赛中,单目相机悬挂于己方雷达站上方3米左右的高度处,朝向己方基地和哨兵附近,可以利用该相机获取基地和哨兵附近敌我双方的机器人的颜色,ID,后期将接入裁判系统数据中的血量信息,一方面,输入到操作间,为操作手提供决策辅助,另一方面,也可以为己方哨兵提供策略。

根据上述需求分析,可以将该项目分解为以下几个子任务

子任务 说明

相机选型与驱动配置 相机视角和焦距选型与驱动配置

前景提取 将运动的车辆从背景中提取出来

颜色识别 将车辆红蓝颜色进行提取

装甲板区域提取 将车辆灯条区域提取出来

装甲板数字识别 将数字识别出来

目标区域跟踪与融合 实现车辆区域的跟踪与检测进行融合

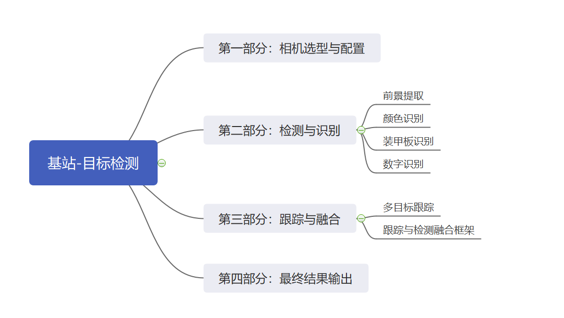

根据第一节中的任务拆分,大致可以分为四部分,第一部分是相机选型与驱动配置;第二部分是检测与识别,第三部分是跟踪和融合,第四部分是最终结果输出。

1)检测与识别包括:前景提取 颜色识别 装甲板识别 数字识别。

2)跟踪与融合包括 多目标跟踪 检测与跟踪框架融合

3)总体方案框图如下:

相机为大恒的MER-131-210U3C(同大恒139套餐), 焦距6mm,视场角45度, 使用画面尺寸1024*1080。

使用该相机的实际效果:

1)画质好,由于画质好,进行运动检测时,会将噪点都识别出来,进行腐蚀操作可以去掉噪点。

2)焦距适中,经测试,在该相机下,最远可以识别11m处的装甲板,稳定识别水平距离9M内的装甲板。覆盖视野如下:

体现在RM2020地图中,则可以覆盖环形高地内,哨轨道兵附近,以及基地附近的机器人。

前景主要基于运动目标检测原理,将场地中运动着的机器人通过前景分离的方式提取出来。

颜色识别方案,主要的方法有两个:

第一种是在BGR空间处理.将BGR三通道分离,获取B和R通道像素,通过与G通道像素做差获取像素值进行处理。

第二种是将图像转到HSV空间,按照红蓝的H值的范围进行划分,从而统计得到红蓝像素点的个数。

装甲板识别方案,同第一视角装甲板识别原理相同,总体方案是在识别到的所有灯柱中,根据先验知识,设定条件,判定平行灯柱。将平行灯柱对应的区间图像扣出来。

数字识别部分,总体方案采用的是SVM进行数字识别的训练,需要注意的地方是:由于该相机安装高度和角度与第一人称视角和其他视角有所区别,经过测试,在开源的数据集中以及第一视角提取的样本的基础上训练得到的模型,识别效果很差,做出了如下改进:

1.使用该相机拍摄车辆的运动数据,使用装甲板识别功能提取图片作为训练用样本集;

2.设立负样本集合,将环境下的背景图,灯光效果,影子效果等容易误识别的图片作为负样本集合;

3,训练前,将图片归一化为25*25左右大小,图片缩小以后效果变好;

训练步骤比较简单,主要是数据集的制作和处理比较麻烦以及需要技巧;

跟踪与融合基本上是通过检测与跟踪进行融合,通过检测来纠正跟踪,再通过跟踪来弥补检测的抖动与丢失

最终基站在检测到基地附近敌我分布之后能够通过裁判系统得到所有机器人的信息,并生成威胁系数:比如首先集火血量低的车辆;识别友军集火目标辅助攻击;根据当前局势选择攻防策略;通过远距离预警补充哨兵视野;分析敌方行为动向等。

对于深度学习在基站目标检测中的应用经验与展望:

深度学习的模型对光照、颜色非常挑剔,这是由于过拟合造成的。由于数据采集使用的设备单一、光照比较固定,所以网络往往会把设备的特征学习下来,其中最敏感的颜色模型,好比说模型训练集使用sony相机拍摄,但是验证集是BMD相机拍摄,这就会使的网络预测准确度断崖下跌,甚至完全不能工作。对于机器人检测模型,由于背景比较单一,导致模型学习了背景信息,导致在分区赛数据集上训练的模型拿到复活赛上使用就会出现问题。

这些问题主要原因还是因为数据过于单一。

为了引导大家能够学习深度学习技术、将深度学习应用到比赛上来、我们也希望建设一个开源数据集平台,便于各个学校分享自己的数据集、共同丰富赛事数据集,在参赛的同时提高深度学习技术,营造RM数据生态圈。

相机为大恒的MER-131-210U3C(同大恒139套餐), 焦距6mm,视场角45度, 使用画面尺寸1024*1080。

使用该相机的实际效果:

1)画质好,由于画质好,进行运动检测时,会将噪点都识别出来,进行腐蚀操作可以去掉噪点。

2)焦距适中,经测试,在该相机下,最远可以识别11m处的装甲板,稳定识别水平距离9M内的装甲板。覆盖视野如下:

发布于2020-3-16

浏览5.1k

相关分类

活动

同城约飞

1

0

1

0